Cela fait maintenant plus de 25 ans que je « fait » des algorithmes. D'abord formé aux maths pures, je suis passé à la logique, puis à la complexité et in fine à la création pratico-pratique d'algos « qui marchent ».

Depuis quelques années, une partie de mes travaux fait partie de ce que l'on appelle maintenant l'intelligence artificielle, et par ailleurs j'utilise l'IA tous les jours pour construire d'autres choses. Et en fait dans les deux cas il ne s'agit pas forcément de la même IA ;) En tout cas le message que je veux délivrer en premier est de que je parle de l'IA en acteur et créateur, mon métier n'est pas de commenter mais de faire.

Parce que les mots sont importants

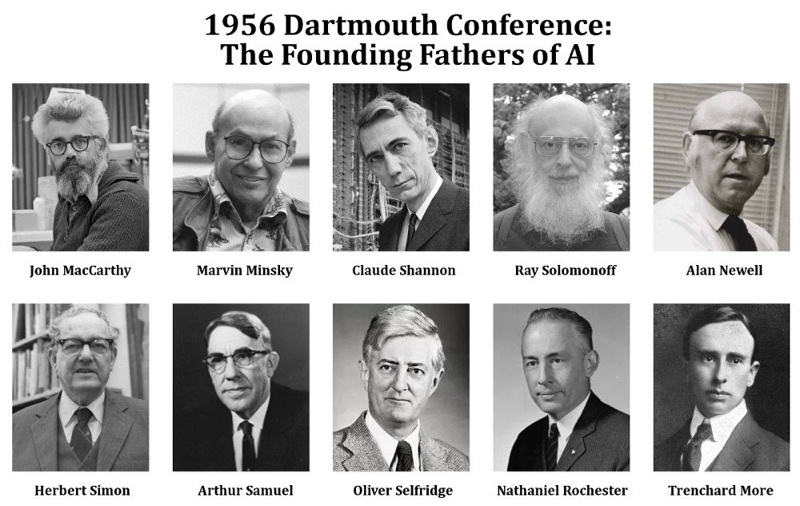

Parce que les mots sont importants il faut d'abord réfléchir au sens de ce vocable, « Intelligence artificielle ». En 1956 a eu lieu à l'Université de Dartmouth (petite fac privée de l'Ivy League, dans le New Hampshire) une conférence assez intimiste (une vingtaine de chercheurs) dont le sujet est celui de faire réaliser par des machines des tâches qui sont usuellement l'apanage de l'être humain. John McCarthy (connu pour la création de LISP entre autres) va par exemple y présenter les stratégies alpha-beta, mais il va aussi et surtout convaincre ses confrères de nommer leur nouveau champ d'étude l'intelligence artificielle...

Ce terme est ancien, et il a survécu car, voulu ou non, c'est un véritable tour de force marketing. La quantité d'imaginaire et de storytelling qui se cache derrière le terme est tel qu'on peut vendre tout et son contraire avec. Techniquement c'est pourtant plutôt simple, dans l'IA il y a de l'apprentissage automatique, de l'optimisation, des méthodes probabilistes, du NL, etc. des disciplines qui existaient avant le mot et qui existeront longtemps après.

Mais l'usage de ce vocabulaire quasi romanesque crée un brouillard cognitif en mêlant la technique, le formel, et le fantasme, l'imaginaire. Je vais essayer de m'en passer dans les prochaines lignes de ce texte.

Capacités et intelligence ne sont pas la même chose

Les capacités des systèmes actuels sont vraiment devenues incroyables. Quand j'étais jeune on aurait parlé de science-fiction pour ce que l'on voit actuellement, et pourtant maintenant c'est devenu une norme, les gens sont blasés (mais c'est en partie une posture). Cette nouvelle norme est pourtant assez mal comprise.

En effet, si on prend un LLM, qui est un objet technique qui pour la plupart des gens est de la véritable magie, on a un objet technique qui résume, traduit, peut coder si on lui ajoute un peu de planification, peut mimer du raisonnement en se parlant à lui-même. En gros il est capable de réaliser de manière stable et continue ce que peut faire un humain bien éduqué.

Ce qu'on voit c'est ce que je vais appeler un changement de régime industriel, et il ne faut pas sous-estimer cela. Mais ce n'est pas de l'intelligence. L'intelligence c'est savoir quand on se trompe, c'est poser un problème que personne ne posait et surtout c'est s'adapter, c'est-à-dire ajuster son raisonnement face à une situation pour laquelle on n'a pas été entraîné et s'actualiser en conséquence. A ma connaissance aucun système actuel n'a cette capacité.

En revanche, la capacité à parler de manière fluide produit l'illusion de la pensée. Quand on y pense c'est normal, car pour observer et valider l'existence de l'intelligence chez autrui on peut observer ses actes, mais aussi et surtout discuter avec cet autrui.

Attribuer l'intelligence à qui manipule le langage, c'est finalement plus un biais cognitif chez l'observateur qu'une propriété du système.

Cette confusion ouvre la porte au seul danger qui compte réellement pour l'instant. Ce danger ce n'est pas pas terminator ou les trombones de Bostrom dans superintelligence, c'est plutôt la lente et silencieuse abdication des humains face à des systèmes qui produisent leurs erreurs avec l'aplomb du vrai. Cette érosion du jugement est pernicieuse et quand on s'en rend collectivement compte cela devient très difficile d'en revenir. Le problème est donc de prendre la sortie d'un système d'IA pour une réponse définitive plutôt que pour une hypothèse à examiner, le problème c'est de cesser de juger soi-même et de devenir l'esclave de la « pensée mécanique ». Au niveau d'usage de ces outils, on peut parler d'une transformation civilisationnelle.

Qualité de décision, perte d'information, pouvoir algorithmique

Vous ne le savez pas, mais depuis 25 ans tous mes travaux scientifiques s'inscrivent dans le cadre d'une unique question : quelle est la relation entre la qualité de la décision et la dégradation de l'information qui sert à prendre ladite décision. J'ai étudié et conçu de nombreux mécanismes algorithmiques qui quantifient la qualité de la décision quand l'information se dégrade, ou qui utilise cette relation pour prendre plus vite des décisions qui sont quasiment (presque) les meilleurs.

Un LLM est de ce point de vue un objet fascinant qui s'inscrit bien dans ce questionnement. C'est en effet un système qui compresse une masse colossale d'information dans un nombre limité de paramètres, puis qui décide à partir de cette compression. La perte d'information est massive et pourtant la sortie semble parfaite tant elle est fluide, et cette fluidité nous fait croire que rien n'a été perdu dans le processus. Caractériser la perte qui existe sans qu'on s'en rende intuitivement compte, la mesurer, la rendre visible, c'est ça le seul travail qui compte réellement quand on analyse les systèmes que sont les grands modèles. Tout le reste en découle, et j'oserais dire de manière provoquante que dans l'état actuel des choses c'est de la métaphysique de salon.

Au-delà de la caractérisation, il y a aussi la nécessité de comprendre ce que ces outils font à ceux qui les utilisent. Un outil n'est jamais neutre. Il transforme celui qui s'en sert. C'est vrai du marteau, c'est vrai de l'écriture, c'est vrai des algorithmes, et c'est massivement vrai d'une IA dont le terrain d'opération est le langage lui-même. Pour la première fois dans l'histoire technique, un outil intervient au lieu même où le jugement se forme avant de devenir décision. Cela crée une forme de pouvoir que les outils n'ont jamais eu auparavant et pire encore, il s'agit d'un pouvoir qui s'exerce sans aucun consentement explicite, par simple usage répété. Ne pas le nommer, c'est s'interdire d'y penser, ne pas y penser c'est y être aliéné (je vous renvoie à la lecture de Gilbert Simondon).

C'est devenu de la pop culture : un grand pouvoir entraine de grandes responsabilités ;) Et effectivement on peut dire qu'il y a un devoir pour ceux qui conçoivent les instruments IA. Dans mes rêves les plus fous l'écosystème tech se met à concevoir des systèmes qui nourrissent l'esprit plutôt de le voir comme une source de revenu. Je ne parle pas d'avoir une pseudo éthique posée sur des briques techniques par ailleurs neutres mais bien de changer des choix d'architecture, d'intégrer dans les systèmes des objectifs différents par construction. Aujourd'hui, les acteurs dominants ont des modèles économiques qui sont alignés sur l'engagement et la captation, pas sur la qualité du jugement qu'ils permettent. Même si il n'y a probablement pas de malveillance réelle, la dynamique des sociétés humains actuelles produit ce phénomène.

La trajectoire technique ?

Sur la trajectoire technique de l'IA, ma conviction n'est pas forcément en phase avec le discours public dominant. La piste qui m'intéresse n'est pas le scaling de modèles uniques toujours plus gros et plus complexes. C'est au contraire le multi-agent : la conversation rapide entre des agents spécialisés par le contexte, qui se vérifient, s'arbitrent, compensent ainsi leurs faiblesses respectives. Chaque agent pris isolément reste limité, mais l'architecture collective peut faire émerger des comportements qu'aucun agent seul n'aurait pu produire. Je pense donc que fondamentalement l'IA est un problème d'algorithmique distribuée, pas de scaling. Et c'est un terrain où les ruptures de capacité ne viendront pas des plus gros acteurs, mais de ceux qui savent composer ces briques avec ingéniosité.

Cette trajectoire est devenue faisable grâce à un phénomène encore sous-estimé : l'inférence devient une commodité. Le coût marginal d'un token tend vers zéro, comme celui de la bande passante ou du cycle CPU avant lui. Quand une ressource fondamentale devient quasi gratuite, ce qui crée de la valeur n'est plus la ressource mais bien l'architecture qui l'orchestre. Les barrières d'entrée que les géants de l'IA ont cru permanentes sont en train d'être submergées, on le voit déjà avec d'innombrables acteurs qui font du SOTA avec des bonnes idées et des (plus) petits modèles.

Sur l'AGI, qui semble obséder beaucoup de monde, je pense que la question est mal posée. Il n'existe aucune définition opérationnelle de l'intelligence générale, aucune métrique acceptée, aucun protocole expérimental qui permette de la trancher.

On ne peut comprendre et agir que sur ce que l'on mesure, et donc sans mesure on ne fait pas de la science et de la tech, on fait juste des discussions de PMU.

Les annonces d'AGI pour telle ou telle année c'est de la communication idéologique et/ou financière, pas de la recherche.

Vous l'avez compris, pour moi la question utile c'est : est-ce que des systèmes artificiels vont devenir massivement plus capables, au point de transformer en profondeur le travail intellectuel humain ?

Et si vous avez tenu jusqu'ici vous savez aussi que pour moi la réponse est évidemment oui. Cela ne se fera pas sous la forme d'un grand soir même si les commentateurs seront capables de dater la chose, mais cela s'inscrira dans un continuum, comme on le voit déjà avec chaque jour une nouveauté ou plus dans le secteur. Il ne faut pas se leurrer non plus, la prochaine vague d'outils transformateurs a toutes les chances de ne pas être un prolongement direct de ce qu'on connaît aujourd'hui. Hardware, architecture de réseau de neurones, maths derrière tout cela, on voit de nombreux acteurs qui explorent des pistes totalement nouvelles.

Pour résumer mon propos en 2-2

- L'IA est l'outil le plus puissant que notre civilisation ait construit pour opérer sur le langage et la décision.

- L'IA a des capacités énormes et une intelligence nulle.

- L'IA façonne les esprits de ceux qui l'utilisent qu'on l'admette ou non. Le danger qu'elle porte n'est pas la superintelligence mais la délégation du jugement humain. C'est un risque civilisationnel, en plus d'être sociétal (notamment en raison de l'impact sur le travail).

- La trajectoire technique n'est selon moi pas dans le scaling mais dans l'architecture. Vive les agents !

- On devrait collectivement travailler à des outils techniques plus vertueux par construction.